(밑바닥부터 시작하는 딥러닝2) 5장. 순환 신경망(RNN)

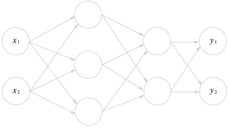

지금까지 살펴본 신경망은 피드포워드라는 유형의 신경망이다. 피드포워드란 흐름이 단방향인 신경망을 말한다. 이 구조는 단점이 있는데, 바로 시계열 데이터를 잘 다루지...

(밑바닥부터 시작하는 딥러닝2) 4장. word2vec 속도 개선

3장에서는 word2vec의 구조를 배우고, CBOW 모델을 구현했다. 여기서 구현한 모델에는 몇 가지 문제가 있다. 말뭉치에 포함된 어휘수가 많아지면 계산량도 커진다는...

(밑바닥부터 시작하는 딥러닝2) 3장. word2vec

이번 장에서는 2장에서 알아본 ‘통계 기반 기법’보다 강력한 ‘추론 기반 기법’을 알아본다. 추론 기반 기법에서는 신경망을 이용하는데, 여기서 word2vec이 등장한다....

(밑바닥부터 시작하는 딥러닝2) 2장. 자연어와 단어의 분산 표현

자연어 처리란 사람들이 평소에 사용하는 말을 자연어라고 한다. 자연어 처리(NLP)는 사람의 말을 컴퓨터에게 이해시키기 위한 기술이다. 자연어 처리가 추구하는 목표는...

(밑바닥부터 시작하는 딥러닝2) 1장. 신경망

벡터와 행렬 import numpy as np x = np.array([1, 2, 3]) print(x.__class__) # numpy.ndarray print(x.shape) # (3, ) print(x.ndim) #...

(시작하세요! 텐서플로 2.0 프로그래밍) 10장. 강화학습(Reinforcement Learning)

강화학습은 실수와 보상을 통해 배우는 알고리즘이다. 신경망이 정답과 예측 사이의 오차를 역전파해서 의미있는 가중치와 편향을 학습하는 것처럼 강화학습은 좋은 선택과...

(시작하세요! 텐서플로 2.0 프로그래밍) 9장. 오토인코더(AutoEncoder)

인코더와 디코더, 잠재변수 오토인코더(AutoEncoder)는 자기 자신을 재생성하는 네트워크이다. 오토인코더는 크게 인코더, 잠재변수, 디코더로 나눌 수 있다. 인코더는 지금까지 컨볼루션 신경망에서...

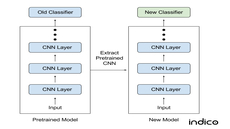

(시작하세요! 텐서플로 2.0 프로그래밍) 8장. 사전 훈련된 모델 다루기(전이 학습)

좋은 성능을 보이는 네트워크는 수백개의 레이어를 쌓은 경우가 대부분이고, 레이어가 늘어남에 따라 네트워크를 훈련시키는 데 걸리는 시간도 증가한다. 다행히 연구자들은...

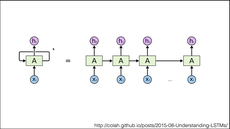

(시작하세요! 텐서플로 2.0 프로그래밍) 7장. 순환 신경망(RNN)

순환 신경망의 구조 RNN은 일반적인 신경망과 유사하지만 되먹임 구조를 가지고 있다는 차이점이 있다. RNN을 통해 할 수 있는 것들 이미지를...

(시작하세요! 텐서플로 2.0 프로그래밍) 6장. 컨볼루션 신경망(CNN)

특징 추출 앞장에서 배운 보스턴 주택 가격 데이터셋에는 주택의 가격을 예측하기 위한 주택당 방의 수, 재산세율, 범죄율 같은 특징(feature)들이 있었다....

(시작하세요! 텐서플로 2.0 프로그래밍) 5장. 분류(Classification)

이항 분류 이항분류는 정답의 범주가 두 개인 분류 문제이다. 여기서는 와인의 당도, 산도, 알코올 도수 등의 데이터를 통해 레드인지 화이트와인인지...

(시작하세요! 텐서플로 2.0 프로그래밍) 4장. 회귀(Regression)

선형 회귀 선형회귀(Linear Regression)는 데이터의 경향성을 가장 잘 설명하는 하나의 직선을 예측하는 것이다. 데이터 준비 아래 코드는 지역의 인구 증가율과...

(시작하세요! 텐서플로 2.0 프로그래밍) 3장. 텐서플로 2.0 시작하기

기본적으로 코드들은 코랩에서 실행한다. 텐서플로 2.x 버전 가져오기 try: %tensorflow_version 2.x except Exception: pass import tensorflow as tf print(tf.__version__) #...

(밑바닥부터 시작하는 딥러닝) 8장. 딥러닝

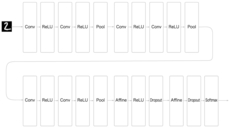

조금 더 깊은 신경망 다음 그림과 같은 조금 더 깊은 CNN을 만들어보고, MNIST데이터셋에 적용해본다. 네트워크 특징 3*3의 작은 필터를 사용한...

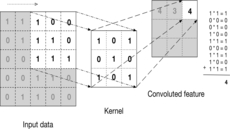

(밑바닥부터 시작하는 딥러닝) 7장. 합성곱 신경망(CNN)

합성곱 신경망은 이미지 인식 분야에서 주로 쓰인다. 완전연결 계층은 평탄화하여 데이터 형상이 무시되는데 CNN은 이를 보완해준다. 지역적인 부분에 대해서 특징을...

(밑바닥부터 시작하는 딥러닝) 6장. 학습 관련 기술들

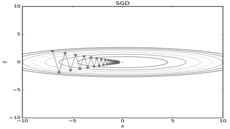

매개변수 갱신 신경망 학습의 목적은 손실 함수의 값을 가능한 낮추는 매개변수를 찾는 것이고, 이를 최적화(optimization)이라고 한다. 확률적 경사 하강법(SGD) 5장에서...

(밑바닥부터 시작하는 딥러닝) 5장. 오차역전파법

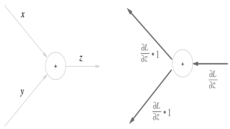

수치 미분은 간단하지만 계산 시간이 오래 걸린다는 단점이 있다. 이러한 단점을 오차역전파법(backpropagation)을 통해 해결할 수 있었다. 계산 그래프 노드: 연산을...

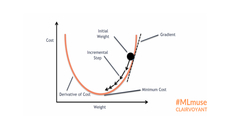

(밑바닥부터 시작하는 딥러닝) 4장. 신경망 학습

패러다임의 변화 학습이란 훈련 데이터로부터 가중치 매개변수의 최적값을 자동으로 획득하는 것을 뜻한다. 기계학습은 데이터에서 패턴을 발견하여 학습한다. 이미지에서 ‘5’라는 숫자를...

(밑바닥부터 시작하는 딥러닝) 3장. 신경망

활성화함수 활성화 함수는(activation function)은 입력 신호의 총합을 출력신호로 변환하는 함수를 의미한다. 계단함수 시그모이드 함수 Relu Leaky-Relu Code def step_function(x): #...

(밑바닥부터 시작하는 딥러닝) 2장. 퍼셉트론

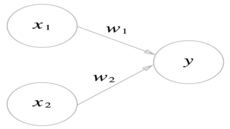

퍼셉트론 퍼셉트론은 다수의 신호를 입력으로 받아 하나의 신호를 출력하는 것을 말한다. 입력신호인 x1과 x2를 넣으면 가중치인 w1과 w2에 각각 곱해진...